Bài viết

So sánh Codex và OpenCode: Nên chọn công cụ Coding Agent AI nào?

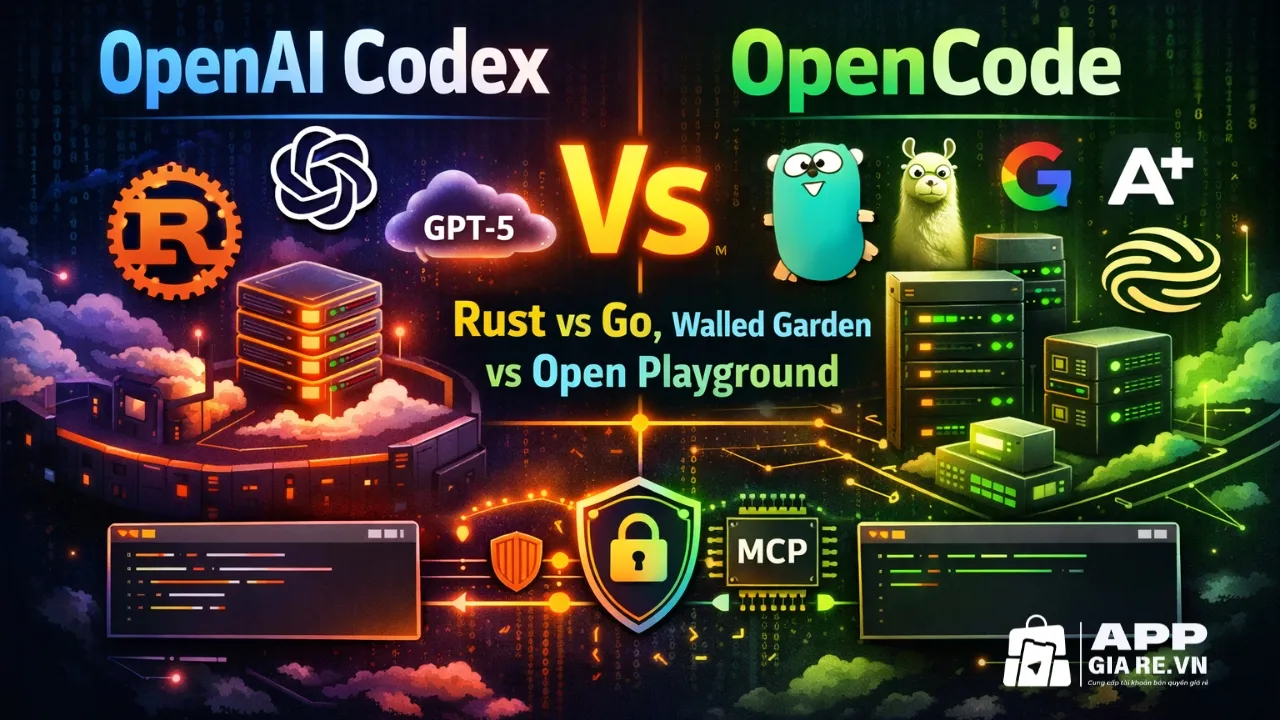

So Sánh Codex và OpenCode thực chất là so sánh hai “coding agent” nguồn mở chạy trong terminal/IDE, nhưng được thiết kế cho hai triết lý khác nhau: Codex tối ưu sâu cho hệ sinh thái OpenAI, còn OpenCode ưu tiên sự linh hoạt đa nhà cung cấp và khả năng tự chủ về hạ tầng.

Từ cuối 2025, nhóm công cụ AI lập trình chuyển dần từ “autocomplete trong IDE” sang “agent” có thể đọc, sửa, chạy code và tự lên kế hoạch nhiều bước, đặc biệt là trong môi trường terminal. Trong bối cảnh đó, Codex CLI của OpenAI và OpenCode nổi lên như hai lựa chọn phổ biến cho lập trình viên thích làm việc trong terminal nhưng vẫn muốn tích hợp với IDE/desktop khi cần, với cộng đồng và hệ sinh thái xung quanh đủ lớn để đầu tư sử dụng lâu dài.

Người dùng vì thế thường phân vân giữa Codex và OpenCode xoay quanh ba câu hỏi chính: hiệu năng và chất lượng khi làm việc với codebase thực, mức độ gắn chặt với một nhà cung cấp model so với khả năng “thoát vendor lock-in”, và tổng chi phí sở hữu nếu dùng hàng ngày trong nhiều tháng hoặc nhiều năm. Bài viết này App Giá Rẻ tập trung So Sánh Codex và OpenCode ở các khía cạnh đó, dựa trên tài liệu chính thức và kinh nghiệm thực tế từ cộng đồng, thay vì quảng bá một bên cụ thể.

👉 Đọc thêm: So sánh Codex và Claude Code: Nên chọn AI nào cho lập trình?

Codex (OpenAI) là gì?

Codex (thường được nhắc đến dưới dạng Codex CLI và Codex app) là coding agent của OpenAI, chạy cục bộ trong terminal, có khả năng đọc, chỉnh sửa và chạy code trực tiếp trong thư mục bạn chỉ định. Công cụ này được xây dựng bằng Rust, mã nguồn mở, tối ưu cho các model GPT-5 Codex mới nhất, và được thiết kế cho workflow “agentic coding”: bạn mô tả yêu cầu, Codex tự quyết định cần sửa file nào, chạy lệnh gì và kiểm tra kết quả ra sao.

Về mặt kết nối hệ sinh thái, Codex gắn chặt với ChatGPT và OpenAI API: bạn có thể dùng Codex CLI miễn phí ở lớp công cụ, nhưng để chạy model thì thường đi kèm các gói ChatGPT Plus/Pro/Business/Enterprise hoặc dùng API trả phí, với lợi thế là tận dụng cùng một tài khoản, thanh toán và policy bảo mật. Ngoài CLI, OpenAI còn cung cấp Codex app trên desktop như một “command center” để điều phối nhiều agent song song, dùng Git worktree riêng cho từng agent để tránh xung đột khi thao tác trên cùng một repo.

OpenCode là gì?

OpenCode là một AI coding agent nguồn mở, được thiết kế “terminal-first” nhưng đồng thời có phiên bản desktop app và extension cho VS Code, Cursor, JetBrains và nhiều IDE khác thông qua Agent Client Protocol (ACP). Công cụ này cho phép bạn tương tác bằng ngôn ngữ tự nhiên để viết, sửa, debug và refactor code, tận dụng LSP (Language Server Protocol) để có hiểu biết sâu hơn về codebase, và hỗ trợ cả Model Context Protocol (MCP) để kết nối thêm các tool bên ngoài.

Điểm nổi bật của OpenCode là triết lý “bring your own key”: bạn có thể cắm API key từ hơn 75 nhà cung cấp model khác nhau (Claude, OpenAI, Gemini, model local qua LM Studio/Ollama…) hoặc dùng một số model miễn phí được đóng gói sẵn, thay vì bị khóa vào một vendor duy nhất. OpenCode được định vị là phù hợp với power user và team cần quyền kiểm soát, audit và tránh lock-in, đặc biệt trong các môi trường nhạy cảm về bảo mật, trong khi vẫn giữ chi phí công cụ ở mức 0 (chỉ trả tiền cho model nếu có).

Bảng so sánh Codex và OpenCode

| Tiêu chí | Codex (Codex CLI – OpenAI) | OpenCode (opencode.ai) |

|---|---|---|

| Nhà phát triển | OpenAI, gắn với hệ sinh thái ChatGPT & OpenAI API | Dự án nguồn mở cộng đồng, không thuộc riêng một nhà cung cấp model |

| Kiến trúc / định vị | Coding agent local-first, tối ưu cho GPT-5 Codex, tích hợp cloud Codex app | AI coding agent terminal-first, kèm desktop và IDE extension, đa nhà cung cấp model |

| Môi trường sử dụng chính | Terminal TUI, tích hợp với Codex app và IDE qua tooling OpenAI | Terminal TUI, desktop app, IDE (VS Code, Cursor, JetBrains, Zed…) qua ACP/LSP |

| Hỗ trợ model | Chỉ OpenAI (GPT-5 Codex, GPT-5.x, o3, o4-mini…) | 75+ provider: OpenAI, Anthropic, Google, local models…, chuyển model linh hoạt |

| Quyền riêng tư | Code chạy local, chỉ prompt và ngữ cảnh trừu tượng gửi lên model | Thiết kế privacy-first, không lưu code; có thể chạy hoàn toàn với model local |

| Giá công cụ | CLI mã nguồn mở, free; chi phí nằm ở gói ChatGPT/API dùng kèm | Công cụ free, mã nguồn mở; người dùng tự trả chi phí model (nếu dùng model trả phí) |

| Hiệu năng thực nghiệm | Thường nhanh hơn OpenCode ở cùng model, đặc biệt GPT-5.2 Codex | Chất lượng tương đương Codex CLI nhưng thường chậm hơn 13–22% ở benchmark |

So sánh chi tiết Codex và OpenCode

Cách tiếp cận Codebase

Hai công cụ khác nhau ở cách “hiểu code”: một bên dựa nhiều vào model, một bên tận dụng thêm hệ thống phân tích code.

- Codex: Của OpenAI, tập trung vào sức mạnh của model — bạn mô tả yêu cầu, agent sẽ tự đọc file, sửa code và chạy test theo từng bước.

- OpenCode: Kết hợp thêm LSP/MCP (hiểu type, lỗi compiler…) nên đọc code “thực tế” hơn, đề xuất sát với lúc build chạy thật.

Xử lý nhiều Task cùng lúc

Khác biệt rõ khi bạn làm nhiều việc trong cùng một repo.

- Codex: Thường xử lý từng task riêng biệt, rõ ràng, dễ kiểm soát.

- OpenCode: Cho chạy nhiều agent song song trong cùng project — mỗi agent làm một việc, giúp tăng tốc khi xử lý nhiều feature/bug cùng lúc.

Trải nghiệm sử dụng

Phụ thuộc bạn quen làm việc kiểu nào: đơn giản – tập trung hay linh hoạt – đa công cụ.

- Codex: Dùng qua CLI, ChatGPT hoặc IDE; có thể đẩy task lên cloud rồi review lại — workflow khá gọn và “chuẩn hóa”.

- OpenCode: Dùng được trên nhiều IDE (VS Code, JetBrains, Neovim…), trải nghiệm linh hoạt hơn nếu bạn dùng nhiều tool khác nhau.

Hệ sinh thái và mở rộng

Một bên dễ dùng lại workflow, một bên mạnh cộng đồng.

- Codex: Có “Agent Skills” để lưu lại quy trình làm việc và tái sử dụng sau.

- OpenCode: Không có hệ skill riêng nhưng nhiều integration từ cộng đồng, dễ mở rộng theo nhu cầu riêng.

Tốc độ và độ ổn định

Hiệu năng khác nhau do cách thiết kế hệ thống.

- Codex: Nhanh và ổn định hơn khi dùng với model của OpenAI.

- OpenCode: Chậm hơn một chút (do xử lý nhiều lớp hơn), nhưng đổi lại linh hoạt hơn.

Quyền riêng tư và Model

Quan trọng nếu bạn làm dự án cần kiểm soát dữ liệu.

- Codex: Gắn với hệ sinh thái OpenAI — dễ dùng nhưng ít tùy biến model.

- OpenCode: Cho chọn nhiều model, có thể self-host — phù hợp team cần kiểm soát dữ liệu và hạ tầng.

Codex phù hợp với ai?

- Lập trình viên và đội ngũ đã hoặc sẽ gắn bó lâu dài với hệ sinh thái của OpenAI

- Người đã dùng ChatGPT cho tra cứu, phân tích dữ liệu, viết tài liệu và muốn mở rộng thêm khả năng coding mà không cần thêm công cụ mới

- Freelancer hoặc developer full-time cần một trợ lý vừa trả lời kiến thức vừa trực tiếp sửa code cho các task nhỏ đến vừa

- Cá nhân có ngân sách khoảng 20–30 USD/tháng, muốn tối ưu chi phí bằng cách dùng chung ChatGPT và Codex thay vì nhiều dịch vụ riêng

- Startup nhỏ hoặc agency (1–5 dev) đã tiêu chuẩn hóa workflow trên ChatGPT và muốn bổ sung coding agent trong terminal

- Team dev cần workflow rõ ràng: dùng ChatGPT cho trao đổi, tài liệu; dùng Codex CLI/app để chạy task nền, generate code và review diff trước khi merge

- Đội ngũ có nhu cầu tích hợp AI vào CI/CD để tự động check code, chạy agent song song và tối ưu quy trình phát triển

- Doanh nghiệp ưu tiên quản trị tập trung: hợp đồng, bảo mật, logging, audit và kiểm soát chi phí trong cùng một hệ sinh thái

- Tổ chức có chiến lược dài hạn sử dụng AI cho nhiều use case (chatbot, data, content, coding) và muốn gom về một vendor duy nhất như OpenAI

👉 Tham khảo: Mua tài khoản Codex nâng cấp chính chủ giá rẻ

OpenCode phù hợp với ai?

- Power user hoặc tech lead coi trọng sự linh hoạt: muốn tự chọn model (Claude, GPT, Gemini hoặc local) và không bị lock-in vào một nhà cung cấp

- Developer đã có sẵn ngân sách model (API hoặc subscription) và muốn gom tất cả vào một công cụ CLI/IDE duy nhất

- Người làm việc hàng ngày trong terminal/IDE, cần một lớp làm việc thống nhất thay vì phụ thuộc vào từng IDE riêng lẻ

- Lập trình viên thường xuyên chuyển giữa nhiều project, nhiều stack (Rust, Python, TypeScript, Terraform…) và cần môi trường làm việc nhất quán

- Developer muốn tối ưu chi phí bằng cách kết hợp nhiều model: dùng model mạnh cho task quan trọng, model local hoặc miễn phí cho task nhẹ

- Cá nhân cần kiểm soát chi tiêu linh hoạt (khoảng 500.000–1.000.000 VND/tháng) thay vì phụ thuộc một gói subscription cố định

- Doanh nghiệp hoặc tổ chức nhạy cảm về dữ liệu, cần giải pháp không lưu trữ code server-side và có thể chạy model local

- Team kỹ thuật muốn tùy biến sâu, đóng góp hoặc fork công cụ nhờ cộng đồng phát triển nhanh và mã nguồn mở

- Người muốn một “lớp AI coding” lâu dài, có thể tích hợp nhiều provider như OpenAI, Anthropic và Google trong cùng workflow

Nên chọn mua Codex hay OpenCode?

Nếu ưu tiên lớn nhất của bạn là “tối ưu cho OpenAI” – nghĩa là bạn đã hoặc sẽ dùng OpenAI cho nhiều bài toán khác nhau, muốn hiệu năng cao nhất khi chạy GPT‑5 Codex và tích hợp chặt chẽ với Codex app, CI/CD và hệ thống quản trị của OpenAI – thì Codex là lựa chọn hợp lý hơn. Khi đó, chi phí chính là gói ChatGPT và token API, đổi lại bạn có một agent được nhà cung cấp model tối ưu từ trong ra ngoài, khả năng cloud offloading, skill system và multi‑agent orchestration mạnh mẽ cho workflow phức tạp.

Ngược lại, nếu bạn đặt nặng tiêu chí linh hoạt, tránh lock‑in và muốn toàn quyền chọn – thay đổi – kết hợp nhà cung cấp model theo thời gian, OpenCode là lựa chọn tự nhiên hơn. Nó cho phép bạn bắt đầu gần như không chi phí công cụ, chỉ trả tiền model nếu cần, rất hợp với cá nhân hoặc team nhỏ có ngân sách giới hạn (dưới 1 triệu/tháng cho cả AI coding) nhưng sẵn sàng đầu tư công sức cấu hình để tối ưu chi phí từng loại task. Với đội kỹ thuật của công ty trung bình đến lớn, nhất là nơi đã có nhiều vendor model song song, OpenCode cũng giúp gom trải nghiệm agent về một mối trong terminal/IDE mà không ép buộc phải chuẩn hóa chỉ một nhà cung cấp.

Ở góc độ hiệu năng thuần túy, các benchmark cho thấy Codex thường nhanh hơn OpenCode khi cùng chạy model OpenAI, trong khi chất lượng output tương đương hoặc nhỉnh hơn một chút ở một số kịch bản. Tuy nhiên, nếu bạn chủ yếu dùng model khác (Claude, Gemini, local) thì lợi thế này giảm bớt và câu chuyện quay về câu hỏi cốt lõi: ưu tiên tốc độ với OpenAI, hay ưu tiên sự linh hoạt model và quyền riêng tư dài hạn – đây mới là điểm khác biệt thực sự ảnh hưởng đến quyết định sử dụng lâu dài.

👉 Đọc thêm: So sánh Codex và Antigravity: Nên chọn AI Coding Agent hay IDE Agent-First?

Kết luận

Tóm lại, So Sánh Codex và OpenCode là so sánh giữa một agent được tối ưu sâu cho hệ sinh thái OpenAI, tích hợp chặt với ChatGPT, Codex app và CI/CD, với một agent nguồn mở chú trọng tối đa vào đa nhà cung cấp model, quyền riêng tư và khả năng tự chủ hạ tầng. Codex phù hợp hơn khi bạn “sống” trong hệ sinh thái OpenAI và đánh giá cao tốc độ, sự tối ưu cho GPT‑5 Codex và các tính năng cloud nâng cao; OpenCode phù hợp hơn khi bạn muốn linh hoạt model, tránh lock‑in, hoặc cần một lớp agent chung cho nhiều provider và môi trường khác nhau.

Nếu bạn còn phân vân, một cách thực tế là chọn một dự án nhỏ, chạy song song Codex và OpenCode với cùng một loại task (ví dụ: refactor module, viết test, sửa bug phức tạp), theo dõi thời gian, chất lượng output và chi phí model trong 1–2 tuần, rồi mới quyết định “gắn bó” lâu dài với bên nào. Bạn đang nghiêng về lựa chọn nào – tối ưu sâu cho OpenAI hay linh hoạt đa nhà cung cấp – và dự án thử nghiệm nào đủ nhỏ để bạn có thể test cả hai trước khi ra quyết định?

Liên hệ hỗ trợ mua tài khoản giá rẻ hoặc nâng cấp chính chủ

- Fanpage: Tài Khoản Bản Quyền – Appgiare.vn

- Liên quan đến bảo hành, hỗ trợ sản phẩm dịch vụ Zalo: 0357 553 403

- Giờ làm việc: 8h00 – 24h (T2 – CN)

Các câu hỏi thường gặp khi so sánh Codex và OpenCode

Codex và OpenCode khác nhau cốt lõi ở đâu?

Codex là coding agent do OpenAI phát triển, tối ưu sâu cho các model GPT‑5.x Codex, chạy local nhưng gắn chặt với hệ sinh thái OpenAI (ChatGPT, Codex app, API). OpenCode là agent nguồn mở, “provider‑agnostic”, cho phép dùng hơn 75 nhà cung cấp model (OpenAI, Claude, Gemini, local…) và nhấn mạnh sự linh hoạt, tránh lock‑in.

Cái nào nhanh hơn và ổn định hơn khi dùng cùng model OpenAI?

Benchmark độc lập cho thấy với cùng model GPT‑5.1/5.2 Codex, Codex CLI thường nhanh hơn OpenCode khoảng 13–22% thời gian chạy trung vị, trong khi độ chính xác và chất lượng output gần như ngang nhau.

Công cụ nào linh hoạt hơn về nhà cung cấp model?

OpenCode linh hoạt hơn rất nhiều: bạn có thể đổi qua lại giữa Claude, OpenAI, Gemini, model local… trong cùng một công cụ, thậm chí trong cùng một phiên làm việc. Codex chỉ dùng model của OpenAI, đổi lại được tối ưu rất sâu cho chính các model này.

Về quyền riêng tư và self‑host thì sao?

Cả hai đều chạy trên máy bạn, chỉ gửi ngữ cảnh cần thiết lên model, nhưng OpenCode còn hỗ trợ “air‑gapped mode” với model mã nguồn mở qua Ollama, cho phép giữ dữ liệu hoàn toàn nội bộ nếu hạ tầng cho phép. Codex dựa hoàn toàn vào hạ tầng OpenAI nên không thể đạt mức “air‑gapped” tương tự, dù vẫn dùng sandbox và hạn chế quyền truy cập hệ thống.

Dùng cái nào thì rẻ hơn cho dev cá nhân?

Nếu bạn đã trả tiền ChatGPT Plus/Pro, dùng thêm Codex gần như không thêm chi phí công cụ, chủ yếu là token sử dụng model. OpenCode bản thân miễn phí, nhưng bạn sẽ phải tự trả cho API của các provider (hoặc đầu tư máy để chạy model local), nên chi phí rẻ hay đắt tùy cách phối hợp model.

Team nhỏ nên chọn Codex hay OpenCode?

Team đã chuẩn hóa trên OpenAI, muốn setup nhanh, ít cấu hình, hiệu năng tốt với model GPT‑5 thì Codex hợp hơn. Team cần linh hoạt về provider, muốn thử nghiệm nhiều model khác nhau hoặc dùng kết hợp model local và cloud, thì OpenCode hợp lý hơn về dài hạn.

Có nên dùng cả Codex và OpenCode song song không?

Nhiều dev chọn combo: Codex cho các task cần tốc độ cao và tích hợp sâu với OpenAI; OpenCode cho các task cần thử nhiều model, chạy local hoặc ưu tiên quyền riêng tư. Cách này tận dụng được điểm mạnh của cả hai nếu ngân sách cho phép.