Bài viết

Grok 4.20 Vừa Lộ Diện, Gemini 3.1 Pro Đã Áp Đảo Benchmark

Bánh chưng còn chưa kịp tiêu hết, giò chả vẫn nằm yên trong tủ lạnh, mà giới AI đã kịp “combat” thêm một vòng mới. Hôm qua râm ran tin về Grok 4.20 Beta. Hôm nay lại thấy benchmark của Gemini 3.1 Pro được tung ra. Không kịp thay áo thật. Giữa một rừng thông tin marketing, thông số kỹ thuật và lời đồn, câu hỏi đáng quan tâm nhất vẫn không đổi: model nào thực sự đáng chú ý, và đáng chú ý theo góc độ nào?

Grok 4.20 Beta mạnh gấp 10 lần, nhưng vẫn cần chờ kiểm chứng

Thông tin về Grok 4.20 hiện vẫn chủ yếu dừng ở mức Beta và rò rỉ. Nhiều nguồn nói rằng bản chính thức có thể xuất hiện vào khoảng tháng 3, kèm theo các nâng cấp như multi-agent và khả năng xử lý tác vụ phức hợp.

Nghe qua thì rất “khét”. Nhưng nếu đứng ở góc độ người dùng thực chiến – dev, content, researcher – thì vẫn cần chậm lại một nhịp.

Cụm “mạnh gấp 10 lần” luôn là thứ gây chú ý, nhưng nó mơ hồ nếu không rõ đang nói về điều gì: tốc độ phản hồi, khả năng suy luận, độ dài context hay chỉ là cải tiến pipeline nội bộ? Khi chưa có benchmark rõ ràng, những con số kiểu này khó dùng làm cơ sở để đánh giá.

Multi-agent cũng là điểm đáng chú ý, nhưng sức mạnh của nó phụ thuộc rất nhiều vào orchestration, quota và độ ổn định. Nếu chỉ dừng ở demo đẹp mà chưa mở API tốt hoặc chưa đủ ổn định để chạy workflow dài, thì vẫn khó đưa vào vận hành thực tế.

Vì vậy, ở thời điểm hiện tại, Grok 4.20 là một thứ “đáng chờ”, nhưng chưa phải thứ để đặt cược ngay cho các công việc quan trọng.

Sức mạnh Gemini 3.1 Pro khi nhìn vào Benchmark

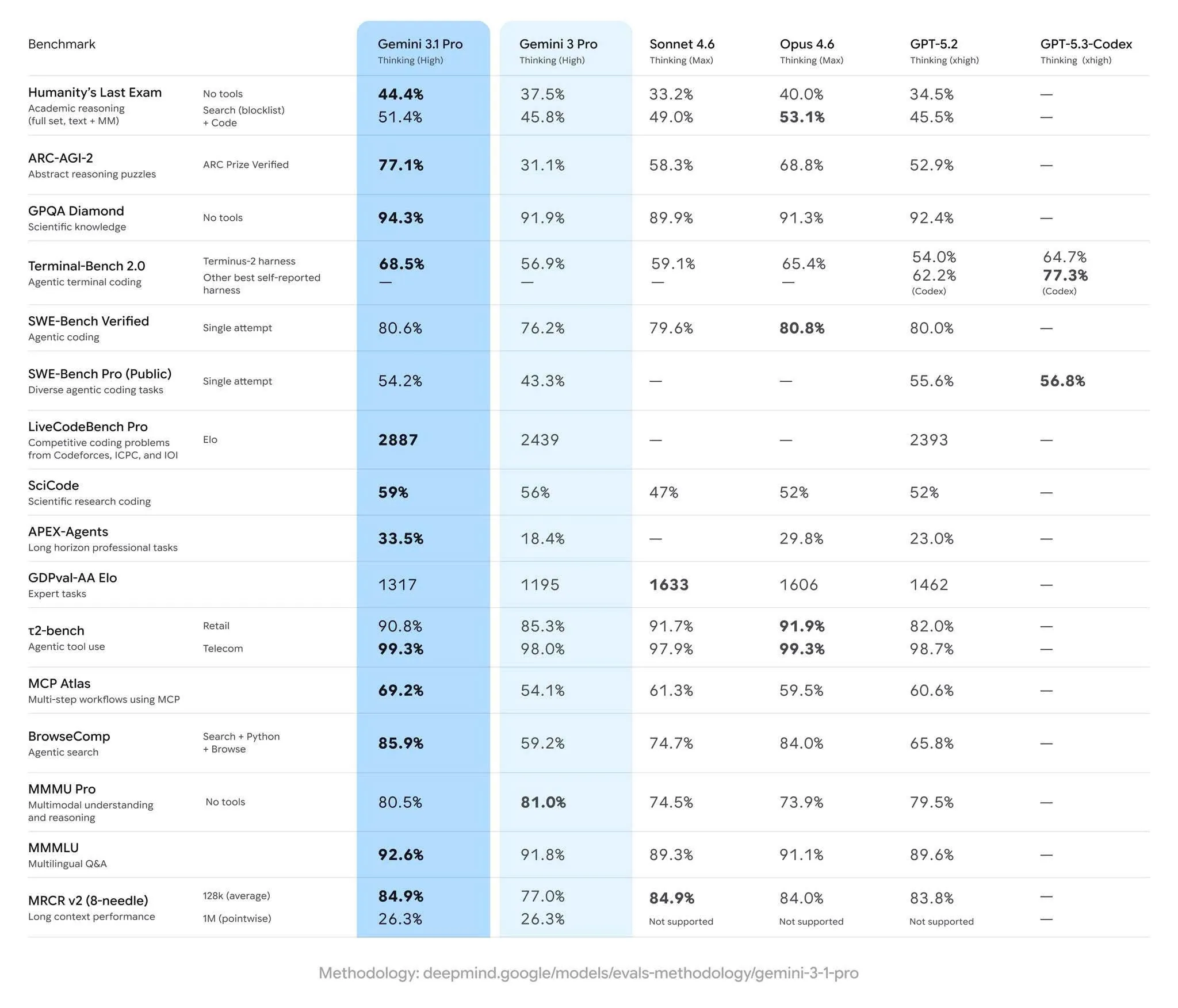

Khác với Grok còn trong giai đoạn chờ kiểm chứng, Gemini 3.1 Pro đã có một bảng benchmark tương đối đầy đủ. Và đây mới là phần thực sự đáng bàn.

Điểm nổi bật đầu tiên nằm ở nhóm bài test liên quan đến scientific research coding. Con số khoảng 59% nghe qua có vẻ khô khan, nhưng với dân kỹ thuật thì lại khá ấn tượng. Đây không phải dạng bài CRUD hay sửa bug đơn giản, mà thường liên quan đến mô phỏng toán học, phân tích dữ liệu lớn, viết pipeline xử lý khoa học hoặc giải các bài toán phức tạp.

Kết quả này cho thấy model không chỉ mạnh về ngôn ngữ, mà còn có khả năng giữ logic dài hạn và hiểu cấu trúc bài toán tương đối tốt. Với data scientist, researcher hoặc dev làm hệ thống phức tạp, đây là điểm cộng thực sự chứ không phải chỉ để “khoe chỉ số”.

Một benchmark khác đáng chú ý là ARC-AGI-2 với mức khoảng 77%. Đây là dạng test đo khả năng suy luận trừu tượng, không dựa vào việc học thuộc kiến thức. Nói cách khác, model cần nhận ra pattern mới thay vì chỉ “nhớ bài cũ”. Trong thực tế, các công việc như thiết kế hệ thống, phân tích business logic hay refactor code lớn đều cần kiểu reasoning này.

Ở mảng lập trình thực tế, kết quả từ SWE-Bench Verified quanh mức 80% cho thấy model có khả năng đọc hiểu codebase thật và sửa lỗi tương đối chính xác. Với dev, đây là chỉ số có giá trị hơn nhiều so với các bài test lý thuyết đơn lẻ.

Thêm vào đó, điểm Elo cao trong các bài test competitive coding cho thấy khả năng xử lý thuật toán và tối ưu tài nguyên của model ở mức tốt. Không phải model nào cũng giữ được phong độ khi gặp bài toán có constraint phức tạp.

Một yếu tố khác thường bị bỏ qua là long context. Với context dài cỡ 128k mà hiệu suất vẫn giữ được ở mức cao, model sẽ hữu dụng hơn hẳn trong các tình huống đọc tài liệu nghiên cứu dài, phân tích hợp đồng, làm việc với codebase lớn hoặc tổng hợp nhiều nguồn thông tin cùng lúc. Nếu model mạnh ở bài test ngắn nhưng “đuối” khi context dài, thì gần như không usable trong môi trường chuyên nghiệp.

Model mạnh thôi chưa đủ, quan trọng là cách vận hành

Đây là chỗ nhiều người bỏ qua. Một model dù có benchmark đẹp đến đâu nhưng nếu quota thấp, khó quản lý workflow, không theo dõi được usage hoặc không xuất được artifact một cách bài bản, thì khi đưa vào công việc thật sẽ rất dễ vướng.

Trong môi trường làm việc, thứ quyết định hiệu quả không chỉ là trí thông minh của model, mà còn là cách bạn kiểm soát phiên làm việc, quản lý tài nguyên và tích hợp vào quy trình sẵn có.

Antigravity chuyển từ công cụ phụ dần thành hệ quản lý AI

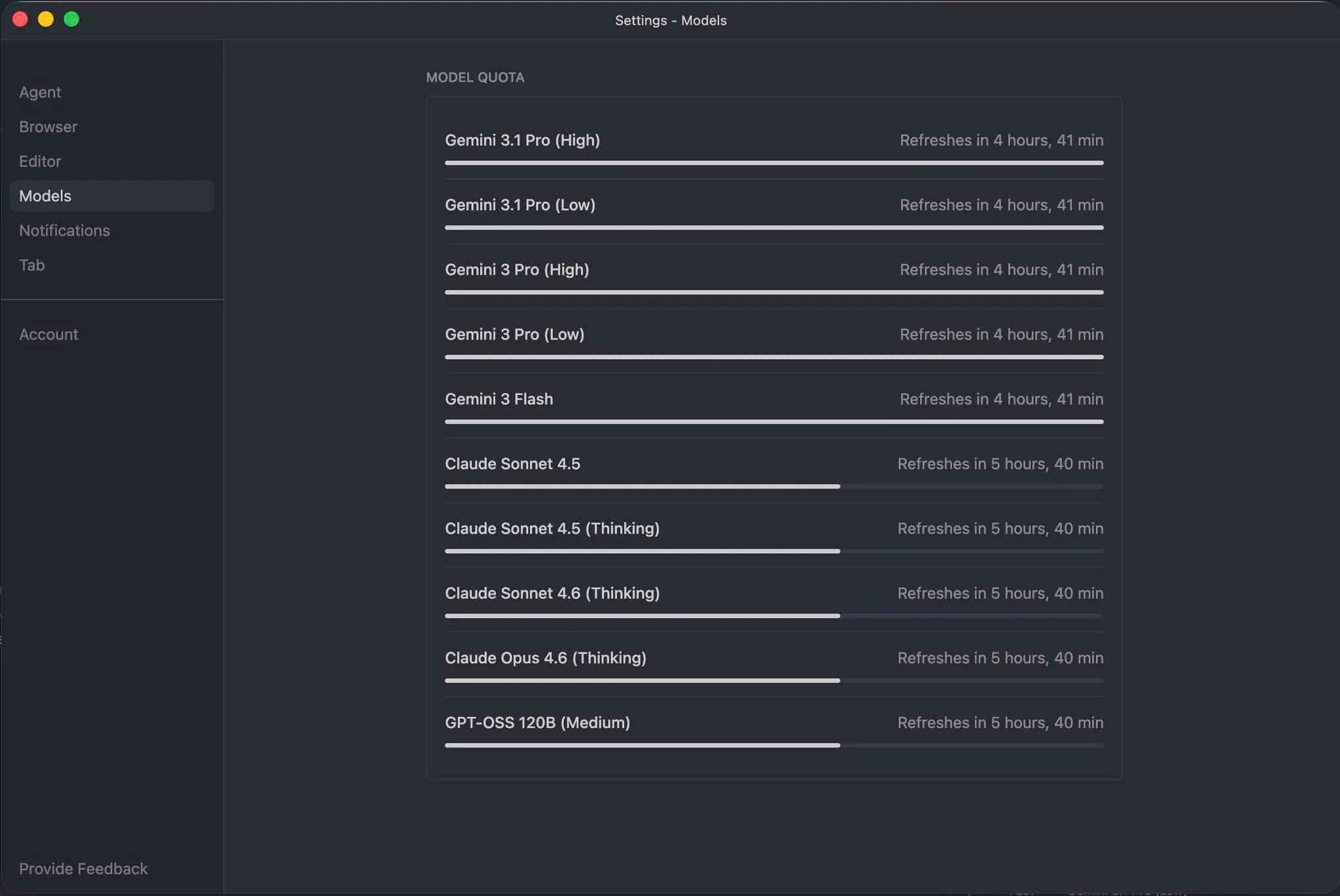

Một điểm đáng chú ý gần đây là các bản cập nhật của Antigravity đang đi theo hướng biến nó thành hệ thống quản lý đa model thay vì chỉ là một công cụ chat.

Việc xem quota từng model trực tiếp trong phần Settings nghe có vẻ nhỏ, nhưng với người dùng nhiều model song song thì lại cực kỳ quan trọng. Bạn biết còn bao nhiêu lượt, khi nào reset và nên dùng model nào cho task nào, thay vì đang làm dở thì hết quota giữa chừng.

Khả năng tải artifact trực tiếp cũng giúp workflow trở nên “pro” hơn: xuất code, báo cáo, markdown, JSON… mà không cần copy-paste thủ công. Thêm vào đó, việc tích hợp trình duyệt và quản lý session giúp quá trình research, so sánh nguồn và phân tích nhiều trang web trở nên liền mạch hơn. Lúc này, AI không còn chỉ là một chat box, mà dần trở thành một công cụ làm việc thực sự.

👉 Tham khảo: Nâng cấp tài khoản Antigravity giá rẻ

Vị trí của Google AI Ultra khi so với Grok 4.20

Khi đặt Grok 4.20, Gemini 3.1 Pro và các công cụ quản lý như Antigravity cạnh nhau, câu hỏi hợp lý sẽ là: Google AI Ultra nằm ở đâu?

Về bản chất, Ultra không phải là một model mới hoàn toàn, mà là gói giúp truy cập phiên bản mạnh nhất trong hệ sinh thái Gemini cùng hạn mức sử dụng cao hơn. Điều này đặc biệt quan trọng nếu bạn chạy workflow dài, làm research nghiêm túc, viết code phức tạp thường xuyên hoặc tạo nhiều nội dung AI liên tục.

Nếu chỉ test cho vui hoặc dùng lặt vặt, bản miễn phí vẫn đủ. Nhưng với những người kiếm tiền trực tiếp từ AI, cần sự ổn định lâu dài và tối ưu năng suất, quota cao và quyền truy cập model đầy đủ mới thực sự có ý nghĩa.

Nói cách khác, đây không phải thứ “ai cũng phải mua”, mà phù hợp với nhóm người dùng chuyên nghiệp, nơi mỗi giờ tiết kiệm được từ AI đều quy ra hiệu quả công việc hoặc doanh thu.

👉 Tham khảo: Nâng cấp Google Ultra giá rẻ

Chọn đúng hệ sinh thái AI để sử dụng

Cuộc đua AI chắc chắn còn dài và sẽ còn nhiều model mới xuất hiện trong năm nay. Grok 4.20 hoàn toàn có thể gây bất ngờ khi ra bản chính thức. Nhưng ở thời điểm hiện tại, Gemini 3.1 Pro đang cho thấy sự ổn định và chiều sâu thông qua dữ liệu benchmark tương đối rõ ràng.

Quan trọng hơn, hiệu quả công việc không chỉ đến từ việc chọn model “mạnh nhất”, mà đến từ việc bạn có một hệ sinh thái đủ tốt: quota đủ dùng, workflow rõ ràng, công cụ quản lý phù hợp và độ ổn định lâu dài.

AI bây giờ không còn là “chat cho vui”. Nó đang dần trở thành hạ tầng năng suất.

Ai biết cách kết hợp model reasoning mạnh, context dài, quota hợp lý và hệ thống quản lý như Antigravity, người đó mới tận dụng được làn sóng này một cách thực sự. Còn nếu chỉ nhìn vào những con số kiểu “gấp 10 lần” mà chưa có dữ liệu thực tế, thì rất dễ bị cuốn theo hype hơn là giá trị thật.